東京大学は2023年12月4日、新たな平均場理論によってAIの「敵対的訓練」のさまざまな特性を明らかにしたと発表した。

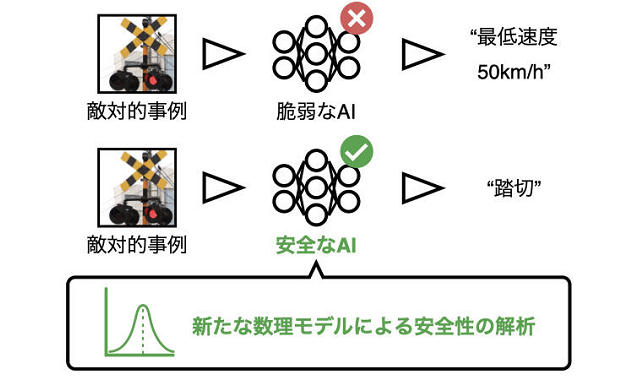

AIに誤認を引き起こさせる「敵対的事例」に対して、正しい認識ができるようにAIを訓練することは敵対的訓練と呼ばれている。敵対的訓練は、敵対的事例に対して一定の有効性が確認されており、今後の発展が期待されている。しかし、この敵対的訓練の原理は、理論的にはこれまでほとんど解明されてこなかった。

今回の研究では、これまで敵対的訓練の解析では注目されなかった「平均場理論」に着目した。平均場理論は、どのような場合にAIが訓練可能になるのか、また高い性能が得られるのかなど、ニューラルネットワークのさまざまな特性を明らかにすることができる。しかし、従来の平均場理論では、ネットワークの狭い範囲しか見通すことができず、敵対的訓練の解析に用いることができなかった。

同大学では、制限を無くした新たな平均場理論を提案。これによりニューラルネットワーク全体の情報伝達を簡単な式で表現できるようになり、敵対的訓練によるニューラルネットワークの変化を解析できるようになった。この理論を用いて敵対的訓練のさまざまな特性を解明。敵対的訓練がうまく機能し、高い性能を発揮するようにするためには、ニューラルネットワークの「幅」を広くすることが重要であることを明らかにした。

近年のAI技術は「深層学習」に代表されるように、可能な限り層を深くすることで優れた性能を発揮する。しかし敵対的攻撃に対しては深さ方向ではなく、ニューラルネットワーク層の入力の並列数を大きくし、幅を広げることが重要であることが分かった。

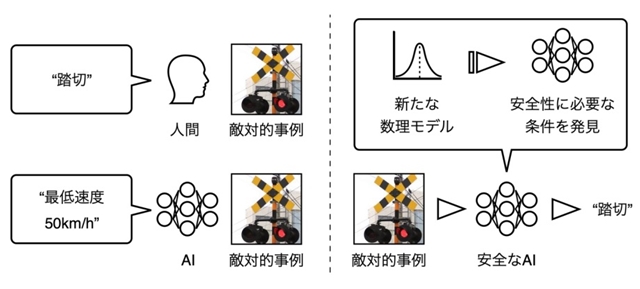

(左)敵対的事例の一例。人間には踏切に見えるが、AIは最低速度50km/hと誤解してしまう可能性がある。

(右)新たな数理モデルによってAIの特性を解析し、安全なAIに求められる条件を明らかにした。

今回解析に用いた新たな平均場理論は、敵対的訓練の解析以外にもさまざまな深層学習手法の解析に応用可能だ。また今回の研究結果はAI解析の新たな理論的枠組みとなることが期待されるという。

関連情報

AIを悪意から守れるか~平均場理論を応用した敵対的訓練の解析~ | 2023年 | プレスリリース | News | 東京大学 大学院 情報理工学系研究科