- 2024-1-23

- 制御・IT系, 技術ニュース, 海外ニュース

- Agent-Deed-Consequence(ADC), AI & Society, Moral Machine Experiment, Phillipa Foot, トロッコ問題, ドライビングシミュレーター, ノースカロライナ州立大学, バイアス, フレームワーク, 仮想現実(VR), 倫理的ジレンマ, 学術, 実験パラダイム, 思考実験, 自動車

有名な思考実験の1つである「トロッコ問題」は自動運転車の道徳的判断研究のための実験パラダイムには不適切であるとし、日常的な交通シナリオ作成と道徳的判断の「Agent-Deed-Consequence(ADC)」モデルを組み合わせた実験的フレームワークを新たに提案する論文が発表された。この研究は米ノースカロライナ州立大学によるもので、2023年11月29日付で『AI & Society』に掲載された。

トロッコ問題とは1967年にイギリスの哲学者Phillipa Foot氏が考案した思考実験で、「多くの人の命を救うために1人の命を犠牲にするかしないか」という倫理的ジレンマを問うものだ。トロッコ問題は自動運転の設計方法を巡る議論でも早くから取り上げられていて、近年、交通における道徳的判断を研究するためのパラダイムとして利用されている。しかし、研究グループは、どちらを選んでも犠牲を必ず伴う二者択一を迫られることは非現実的であると指摘し、トロッコ問題は行為者の性格を考慮に入れておらず、危険の度合いが低い日常の交通シナリオの研究には役に立たないとしている。

人間のドライバーは、事故が発生したり道路上に障害物が現れたりしたのを見たときに、どう反応するかを一瞬で判断するが、自動運転は人間とは異なり、あらかじめ設定された道徳的な常とう手段に従って選択をしなければならない。つまり、自動運転車の意思決定は事前にプログラムされていなければならないのだ。

この欠点は自動運転のトレーニングデータとして人間の参加者の反応を収集する際に現れているという。避けることができない交通事故に関して何百万もの回答を収集したオンライン調査「Moral Machine Experiment」について、研究チームは、トロッコ問題に着想を得たシナリオの多くは、犠牲を伴う非現実的で単純な二項対立頼みで生態学的妥当性を欠いているため問題があるとしている。このようなシナリオでの選択には、必ずしも自動運転に導入してほしくない人間のバイアスが反映されることも多い。

「反応時間、社会的背景、認知的怠惰による人間のバイアスや制限を回避すると同時に、人間の常識や道徳的直観に沿った意思決定システムを作ることが目標です」と、同大学のVeljko Dubljević准教授は述べ、「そのためには、人間が判断するために最適な条件を作り出して、人間の道徳的直観を研究することが極めて重要」としている。

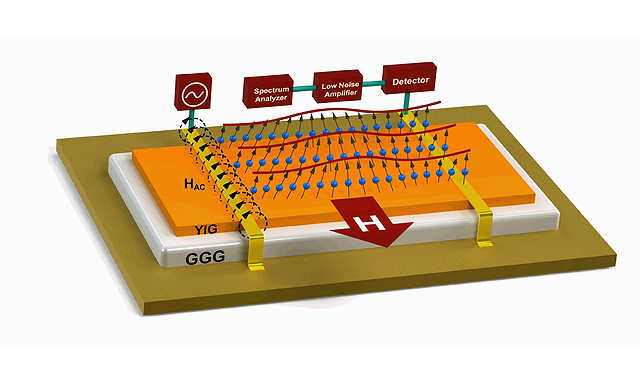

そこで研究チームは、仮想現実(VR)と、二項対立的な解決策のない日常の交通シナリオを組み合わせて、より現実的な環境を作り出した。また、行為者(Agent)、その人の行為(Deed)、もたらされる結果(Consequence)の3要素からドライバーの「性格」を判断するシステムを導入した。

ただし、自動車は機械であり、現時点で人間や動物のような性格や気質を持ってはいないことから、性格に基づく評価をあまり認めていない倫理学者もいる。この新しいフレームワークはまだ初期段階であり、人間の参加者は、行為者としてではなく観察者として判断を下すだけだ。しかし、研究チームは、VRとドライビングシミュレーターを使って、一人称の意思決定のためにこの種の実験を再設計したいと考えているという。

関連情報

- To Help Autonomous Vehicles Make Moral Decisions, Researchers Ditch the ‘Trolley Problem’ | NC State News

- The “Trolley Problem” Doesn’t Work for Self-Driving Cars – IEEE Spectrum

- Moral judgment in realistic traffic scenarios: moving beyond the trolley paradigm for ethics of autonomous vehicles | AI & SOCIETY