- 2022-11-28

- 制御・IT系, 技術ニュース, 海外ニュース

- 2次元画像セット, 3次元モデル, Deep Continuous Artefact-free RI Field(DeCAF), Nature Machine Intelligence, Neural Fields, ワシントン大学, 光学顕微鏡技術, 学術, 強度回折トモグラフィー(IDT), 機械学習アルゴリズム, 深層学習, 顕微鏡

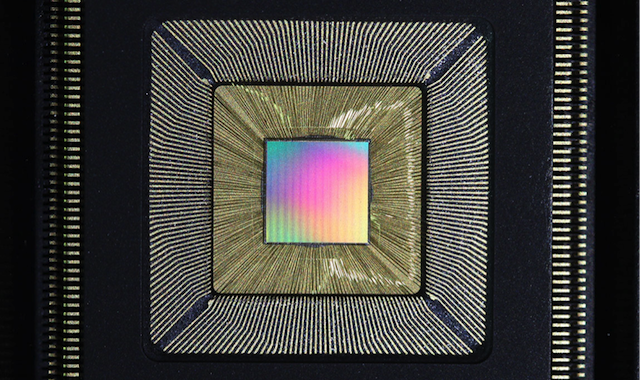

ワシントン大学を中心とした研究チームが、市販の標準的な顕微鏡を使って撮影した、部分的な2次元画像セットから、連続的な3次元モデルを作成できる機械学習アルゴリズムを開発した。同研究成果は2022年9月16日、「Nature Machine Intelligence」に掲載された。

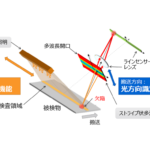

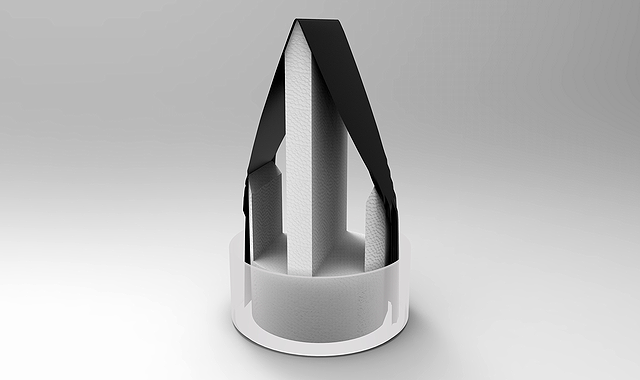

同研究は、強度回折トモグラフィー(IDT)と呼ばれる光学顕微鏡技術の一種。IDTは、2次元強度測定のデータセットから3次元屈折率分布を画像化する。位相情報の損失や円すい状のデータ欠損が原因となるアーティファクトのない、屈折率マップの再構築は、IDTの根本的な課題となっている。

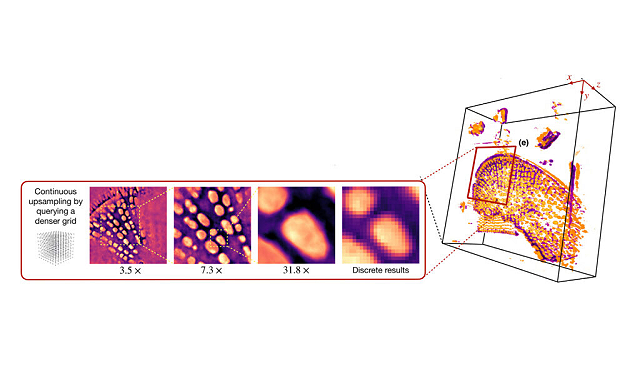

研究チームは、Neural Fieldsと呼ばれる深層学習の手法を用いて、この課題を克服した。Neural Fieldsは、物理場の連続表現を学習するために最近登場した手法だ。座標を基盤としたニューラルネットワークを使用し、空間座標に対応した物理量マップを学習する。学習が完了すると、任意の座標での画像データが得られる。

研究チームは、Neural Fieldsに基づくIDT法として、「Deep Continuous Artefact-free RI Field(DeCAF)」を開発した。DeCAFは、強度のみの測定と限られた角度での測定から高品質な屈折率の連続表現を学習できる。

Neural Fieldsの強みは、大量の類似データで学習させる必要がないことだ。つまり、DeCAFは、グランドトゥルースの屈折率マップなしに、IDTフォワードモデルを使用してテスト試料の顕微鏡画像から直接学習する。十分な数の試料の2次元画像データがあれば、欠損データ部分を埋めた試料全体を表現できるのだ。

研究チームは、生体試料での実験とシミュレーション結果を用いて、DeCAFを定性/定量的に評価した。その結果、DeCAFは高いコントラストでアーティファクトのない屈折率マップを生成でき、既存の手法と比較して平均二乗誤差を最大2.1倍まで低減できると分かった。

DeCAFモデルを使用すれば、生成した細胞の全体像をコマのように回転させることや、拡大してより詳しく調べることも可能だ。さらには、モデルを使って他の数値計算をし、別のアルゴリズムに送れる。モデルには細胞の連続した屈折率を表した完全な情報が含まれているため、いつでもDeCAFで再作成でき、画像ファイルを保存しておく必要がなくなる。