- 2020-7-28

- 制御・IT系, 研究・技術紹介

- 3DCG, AI, AlexNet, Compute Unified Device Architecture, Convolutional Neural Network, CUDA, DGX-2, DNN, GaN, GeForce GTX 580, GPU, ILSVRC, IoTデバイス, NVIDIA, RNN, カンブリア紀, ディープニューラルネットワーク, ニューラルネットワーク, ビッグデータ, 畳み込みニューラルネットワーク

NVIDIA シニアソリューションアーキテクト 室河徹氏

近年、AI(※1)やニューラルネットワーク(※2)というキーワードをよく耳にするようになりました。特に自動車業界で加速する自動運転開発において、ニューラルネットワークを使った画像認識技術、AIによる統合的な自動運転制御に関する研究開発が進んでいます。

今回の連載では、NVIDIA シニアソリューションアーキテクト 室河徹氏にお話を伺い、AI関連技術の急速な発展を支えるGPU(※3)やニューラルネットワークについて、自動運転車開発の切り口で紹介していきます。全3回の構成で、第1回目は「GPUが加速するAI開発」です。(執筆:後藤銀河)

(※1)Artificial Intelligence:人工知能

(※2)Neural Network:脳神経のように結合したノードによって問題解決する数理モデル

(※3)Graphics Processing Unit:画像処理に特化した演算装置

AIの発展を促した三つの要因

――最近、いろいろな分野でAIが活用されるようになってきました。これにはどのような背景があるのでしょうか?

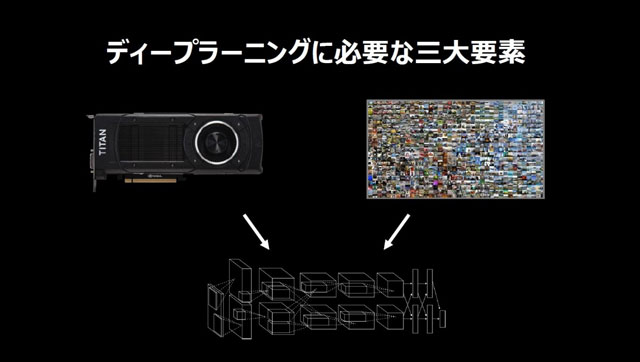

[室河氏]AI開発が急速に発展した背景には、大きく三つの要因があります。一つは、センサーやIoTデバイスの普及、高速通信網の整備などにより、いわゆるビッグデータが集めやすくなったこと。二つ目はそのビッグデータを処理するための膨大な並列演算を短時間で実行できるGPUが登場したこと。そして三つ目は、前の二つの要因によってGPUとビッグデータを使ったDNN(Deep Neural Network:ディープニューラルネットワーク)の開発が進んだことです。

GPUとビッグデータを組み合わせることで、効率的なディープラーニングが可能になった。

[室河氏]以前はビッグデータと呼ばれる膨大なデータを集めることは容易ではなかったし、それを学習させるための強力なコンピューティングパワーもありませんでした。実はニューラルネットワーク自体は半世紀以上も前に登場した技術なのですが、それを上手くトレーニングすることができず、なかなか浸透しなかったのです。しかし、ここ数年AI開発に適した環境が整ってきたことで、多くの分野で使われるようになってきました。

――GPUというと、PC用のグラフィックスボードに搭載されているデバイスというイメージがあります。

[室河氏]NVIDIAは、1993年に創業して、3DCG(3次元コンピュータグラフィックス)を高速処理するためのGPUを開発/販売していました。そのため、GPUもPC用、ゲーム機用というイメージが強いのですが、実は今ではデータセンター向けの機器や自動車の自動運転向けの機器も、大きなビジネスの柱となっています。

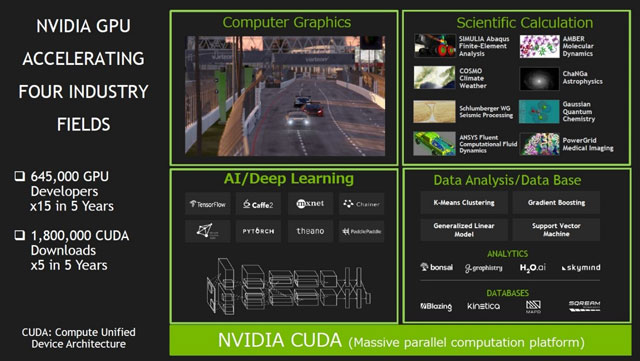

GPUはCG処理だけでなく、AI開発でも活用されている

[室河氏]GPUは、当初CGの描画処理のために開発されましたが、エンジニアや研究者が描画に必要となる強力な並列演算能力が、科学技術演算を行うのに適していることに気づき、やがて機械学習やディープラーニングを用いたAI開発に応用されるようになりました。こうした流れの中で、弊社もGPUを汎用コンピューティング向けに活用するための、「CUDA:Compute Unified Device Architecture(クーダ)」という並列演算用開発プラットフォームを提供しています。

GPUは、CGに加え、計算科学、AI/ディープラーニング、データ分析という4つの産業領域で活用されている。

[室河氏]CUDAのような汎用コンピューティング向けのGPU活用技術は、「GPGPU (General-Purpose computing on Graphics Processing Units)」と呼ばれていて、これによって、GPUは従来のグラフィックス処理だけでなく、計算科学、AI、ディープラーニングといった幅広い用途で活用されるようになったのです。

CPUとGPUの違い――画像処理に特化したチップの特徴とは

――ビットコインのマイニングに大量のGPUが使われて、需要が急増したというニュースもありましたが、それもGPGPUなんですね。GPUが本来目的としていたグラフィックス処理との近似性とは、具体的にどのようなことなのですか?

[室河氏]コンピュータの中心はCPU(Central Processing Unit)で、CPUはOSを動かしたり、入出力を制御したり、様々なアプリケーションを動かしたりと、コンピュータプログラムを処理するため、連続的な計算処理が得意です。それに対して、グラフィックスのような比較的単純で定型的な処理をするために専用設計されたGPUは、同じ演算器が大量に並んでいます。一気に同じ演算をする、いわゆる並列演算が得意です。CPUのコアが数個なのに比べ、GPUのコアは数千個もあって、このGPUが備える特徴がニューラルネットワークの特徴と非常によくマッチングするため、GPUを使った実装が主流になりました。

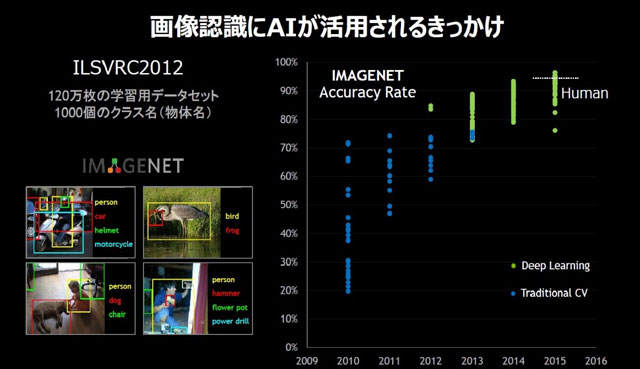

ディープラーニングとニューラルネットワークが特に注目されるようになったのは、「ILSVRC (ImageNet Large Scale Visual Recognition Challenge)」というコンテストです。「ImageNet」というのは、画像認識ソフトウェアの研究用に用意された大規模な視覚データベースで、1400万枚以上の自然画像を含んでいます。この中から、1000種類のラベルが付けられた120万枚の画像を取り出して、認識率を競うコンテストで、2010年から開催されています。

ILSVRCにおける認識率の遷移。

[室河氏]ILSVRCでは、課題として与えられた画像のどこに何が写っているのか、その分類の正確性を競うわけですが、従来のコンピュータビジョンによる正解率は、最高でも70%程度でした。ところが2012年に、カナダのトロント大学名誉教授 ジェフリー・ヒントン氏率いるチームが、「AlexNet」というニューラルネットワークを使って一気に80%以上という正解率を叩き出し、圧勝しました。

それをきっかけに、2013年以降はほぼディープラーニングとニューラルネットワークを使った画像認識へと変わってきています。毎年のように新しいモデルが登場し、それによって認識率もどんどん高くなっています。2016年の時点で、特定の分野においては人間の認識率を超えるようなスコアが出るようになりました。

ニューラルネットワークが画像認識機能を飛躍的に高めた

――AlexNetによって、段違いにスコアが上がっていますね。これは、どのようなものなのでしょうか?

[室河氏]AlexNetは、ニューラルネットワークの中でも、人間の視覚の仕組みをモデルにした畳み込みニューラルネットワーク(CNN:Convolutional Neural Network)と呼ばれるものです。人の顔画像の認識を例に、処理の流れを説明すると、まず入力された顔の画像に対して最初の層のニューロンが反応し、その情報が次の層のニューロンに伝搬し、顔の様々な特徴を抽出していきます。ニューロンの結びつきの強さは、畳み込みフィルタによって実装されるのですが、フィルタの係数を大量の画像を使った学習によって調整します。AlexNetは5層の畳み込み層を使っています。さらに後段で3層の全結合層を通して、それぞれの特徴がどのような関係性にあるのかを捉えて、個別の顔として認識するという仕組みです。

――ニューラルネットワークといってもいろいろな種類があるわけですね。

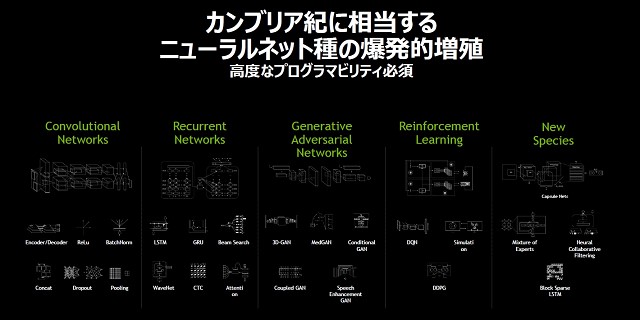

[室河氏]様々なニューラルネットワークを開発するためのフレームワークが必要になってきます。最近ではオープンな環境がいろいろ出てきていて、例えば機械学習用ソフトウェアライブラリでは、Googleの「TensorFlow」などが良く知られています。このようにして、様々なニューラルネットワークのモデルが提案されて、徐々に自然淘汰されている状況です。

一言でニューラルネットワークといっても、その数は非常に多く、次々に新しいものが生み出されている。

[室河氏]初めはシンプルなCNNで、段数もそれほど深くありませんでしたが、ある層の出力を再び入力とする再帰(リカレント)結合をもつRNN(Recurrent Neural Network)や、GAN(Generative Adversarial Networks)と呼ばれる敵対的生成ネットワークなど、いろいろな方式のニューラルネットワークが出てきています。この状況は、地球の歴史の中で、古生代に動物の多様性が一気に増大したカンブリア紀に似ているといわれています。

――カンブリア紀というと、三葉虫などがいた時代ですよね。ニューラルネットワークも生き物のように進化しているということですね。

[室河氏]ここ数年、ニューラルネットワークの複雑性が高くなるに従って、必要とされる演算量も非常に多くなっています。2012年のILSVRCに登場したAlexNetは、弊社の「GeForce GTX 580」というGPUを使ってトレーニングされたのですが、当時は6日かけて最終的な形にしています。その後、2018年にGPUをベースとしたディープラーニング用スーパーコンピュータ「DGX-2」が登場しましたが、それを使うと約18分でトレーニングが完了します。ニューラルネットワークの複雑性も高まっていますが、それに対応するハードウェア、GPUもどんどん進化しています。

次回は「ニューラルネットワークと自動運転」と題して、お話を伺います。

室河徹(エヌビディア シニアソリューションアーキテクト)

1992年、日本テキサス・インスツルメンツ株式会社に入社、CPUやDSP、携帯電話向けSoCの製品マーケティング・技術に従事。2015年、エヌビディア合同会社に入社。自動車向けSoCに関する技術に携わっている。

取材協力先

ライタープロフィール

後藤 銀河

アメショーの銀河(♂)をこよなく愛すライター兼編集者。エンジニアのバックグラウンドを生かし、国内外のニュース記事を中心に誰が読んでもわかりやすい文章を書けるよう、日々奮闘中。