- 2020-8-4

- 制御・IT系, 研究・技術紹介

- ACC, ADAS, AI, DRIVE AGX Pegasus, DRIVE Constellation, DRIVE Constellation Simulator, DRIVE Hyperion, GPU, ILSVRC (ImageNet Large Scale Visual Recognition Challenge), LKA, NVIDIA, Tesla, Uber, アウディ, アダプティブクルーズコントロール, ニューラルネットワーク, 仮想現実(VR), 日産, 自動運転

NVIDIA シニアソリューションアーキテクト 室河徹氏

歴史あるメーカーからEV専業の新興メーカーまで、世界中の自動車メーカーやサプライヤが自動運転の実現に向けてしのぎを削っています。高い安全性や即応性が求められる自動運転機能に欠かせないAI関連技術について、第1回「GPUが加速するAI開発」、第2回「ニューラルネットワークと自動運転」と、NVIDIA シニアソリューションアーキテクト 室河徹氏にお話を伺ってきました。

最終回となる第3回では、「自動運転開発の現状と今後」をテーマに、自動運転機能の開発プロセスの全体像、そして完全自動運転の実現に向けた展望などを紹介します。(執筆:後藤銀河)

第1回目:GPUが加速するAI開発。AIの発展に必要な3つの要素とは?――NVIDIA 室河徹氏

第2回目:ニューラルネットワークと自動運転。多様なネットワークを組み合わせて多重化、冗長化で安全性を担保する――NVIDIA 室河徹氏

――御社は創業以来、半導体の開発/販売を業態の中心に置かれていたと理解していますが、これまでお話を伺う中で、ニューラルネットワークを中心としたソフトウェア開発の比重がとても高くなっていることに驚かされました。

[室河氏]そうですね。NVIDIAの従業員数はグローバルで1万3000人くらいですが、最近ではソフトウェア関連のエンジニアが採用の中心になっています。

――自動運転車についても、個々の機能の提供にとどまらず、レベル2+(部分運転自動化、レベル2の高機能化)を実現できるパッケージとして「DRIVE Hyperion」を提供されていますが、大手自動車メーカーでも、なかなか実現できていない部分だと思います。

[室河氏]自動運転車を実現するということは、とてつもなく大変な試みです。NVIDIAでは、自動運転の基本的な要素である認識機能、自車位置の推定、走行プランニング/制御用ソフトウェアを構築し、GPUを中心とした高性能なコンピューティング・プラットフォームに適用することで、「自動運転車の実現」に取り組んでいます。

――自動車の開発プロセスも、近年はモデル化、デジタル化が進んでいますが、それでも旧来の試作車両による性能確認、品質確認は重要なプロセスとして位置付けられていると思います。これはどのようにお考えでしょうか。

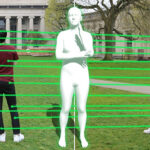

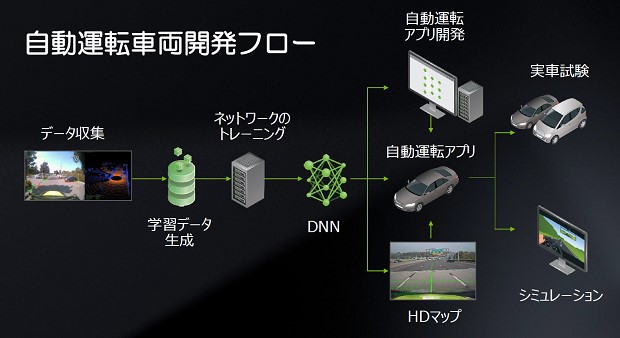

ベースとなるDNNの開発、自動運転アプリの開発、そしてシミュレーションから実車による走行試験まで、一気通貫した環境が構築できる。

[室河氏]弊社の自動運転車両開発の特徴は、前回説明したDNNの開発、自動運転アプリの開発、HDマップ(自動運転向け高精度3Dマップ)の作製、それらを使った実車試験までカバーしていることです。そして開発されたソフトウェアは、「DRIVE Constellation」プラットフォーム上で、仮想現実(VR)での自動運転車の走行シミュレーションによって検証を行うことができます。

シミュレーターによって、実車では不可能なテストシナリオの実施が可能

[室河氏]このDRIVE Constellationは、VR環境でテストを実行するため、強力なGPUを備えた二つのサーバーで構成されています。一つは、自動運転車のカメラやレーダー、センサー類をシミュレートするソフトウェア「DRIVE Constellation Simulator」です。まるで本物のように見えるVR環境の中で、実車走行では再現が困難なケース、例えば大雨や吹雪といった気象条件や、異なる路面状態、日照の条件などを自由に作り出すことができます。

もう一つのサーバーは、車載コントロールユニット内に搭載される自動運転のソフトウェアスタックを実行できる「DRIVE Constellation Computer」です。320TOPSという強力な演算能力を備えるAIコンピュータ「DRIVE AGX Pegasus」を使い、自動運転ソフトウェアに対して、現実世界を走行しているようなセンサーデータを使ったシミュレーションが可能です。

[室河氏]重大な事故につながる可能性が高い自動運転機能には、充分なテストが必要です。DRIVE ConstellationによるVR空間のシミュレーションを繰り返すことで、例えば実車実験では実施不可能な2億kmの走行試験も可能になります。

――確かに実車で実際に2億kmも走ることはできないですね。ソフトウェアの機能をテストするために、無限に近い組み合わせをシミュレーションで検証できるということですね。

[室河氏]シミュレーションによってテストをしたうえで、実際に実車を使った試験も行っています。もちろん、自動運転車両を安全に運用するための認定を受けたテストドライバーが運転し、システムの監視は助手席に乗車したコーパイロットが受け持ちます。現実の高速道路のインターチェンジを走行したり、車線変更などの動作を試しながら、様々なソフトウェアコンポーネントを、現実世界でテストしています。

サンタクララの本社周辺の公道を使ったり、世界各地でテスト車両を運用しています。日本にも2台配備しています。

強力なシミュレーションに加え、実際の車両を使って世界各地で走行実験やデータ収集を行っている。

メーカーの開発プロセスの違いが自動運転の目標設定の違いの一因

――ここで、自動運転機能開発の現状について、伺いたいと思います。多くの自動車メーカーが、レベル2自動運転を当面の目標においている一方で、TeslaやUberはレベル4(地域を限定した完全自動運転)、レベル5(完全自動運転)の実現を目指しています。この差にはどのような理由があると思われますか?

[室河氏]まず、これまで一般の自動車を開発してきたメーカーやサプライヤは、ADAS (Advanced Driver-Assistance System)ベースの自動運転システムや自動ブレーキを発展させることで、自動運転を実現するというアプローチをとっています。

これは既存の開発リソースを活用する積み上げ型の開発プロセスをとっているためだと思われますが、一方でTeslaなどは完全自動運転を目指すようなシステム開発から始めているのです。比較してみると、そもそも自動運転を目指すアプローチが違っていると感じます。

――自動車メーカーは既存の技術をベースに自動化する流れなので、まずはレベル2を目指しているということでしょうか。

[室河氏]前車との車間距離を保ちながら単一車線を走るACC(Adaptive Cruse Control:アダプティブクルーズコントロール)や、走行車線から外れないように車線の中央を走るLKA(Lane Keep Assistance:レーンキープ)など、自動運転のために必要な既存機能を組み合わせて、少しずつ発展させるというアプローチです。Teslaのアプローチは、NVIDIAの自動運転スタックに近いもので、AIを多用してオートパイロット機能を実現しています。

既存の自動車メーカーとTeslaやUberとでは、自動運転開発に対するアプローチが違うと分析する室河氏

[室河氏]それに自動運転は、どこまでやるかで超えるべきハードル、障壁が全然違います。これまでは人間のドライバーが運転することが前提であり、自動車はそのように設計されてきました。しかし、東京オリンピックに向けて各社が取り組んでいるような自動運転、例えばロボットタクシーであれば、ドライバーシートに誰もいないとか、究極であればハンドルがないとか。個人向けの自動車とは違った開発が求められていると思います。

日産のプロパイロットでは、ドライバーがよそ見していないかをカメラでずっと監視していますし、いざというときにはドライバーがオーバーライドできるようなシステムです。これを無くして、完全に機械任せにしようとすると、システムの難易度は急に高くなります。安全性を保障するため、コンピュータも完全に二重化する必要がありますし、高速道なのか一般道なのか、HDマップがないところでも実現するのかで、全く難易度が違います。

個人的には、日本の自動運転が目指すべき目標は、高精細地図がないような過疎地でも、そこに暮らすお年寄りに代わって自動運転ができることかなと思っています。

ニューラルネットワークの急激な進歩が完全自動運転開発を加速する

――アウディなども機能的にはレベル3(条件付き自動運転)を実現していますが、法規制などの制限もあって、日本市場には導入できていません。以前、自動運転に関わるエキスパートの方にお話しを伺ったことがありますが、完全自動運転の実現は早くても2050年、とする意見もありました。前提条件の違いもあるのでしょうが、完全自動運転はいつ頃実現できるとお考えですか?

[室河氏]これまでお話してきたように、実際の交通の環境は複雑です。物陰に何か隠れていたり、突然変化する状況に対応するためには、大量の学習が必要になります。外界の認識にはニューラルネットワークを使うことになりますが、どこまで認識するのか、どこまで演算するのか、という線引きは必要です。弊社のプラットフォームを使うことで、レベル2+を実現することは可能ですが、それ以上の機能を提供できるような開発も行っています。

日本では完全自動運転の実現は、早くても2030年頃だろうという見方が一般的でした。ところが、ここ数年は世の中の技術の進歩が非常に速くなっています。例えば販売が好調なTeslaの車に搭載されているAutopilotなども、世界から注目を集めていますね。

――第1回でお聞きした、2012年の「ILSVRC (ImageNet Large Scale Visual Recognition Challenge)」をきっかけとしたニューラルネットワークの急激な進歩が後押ししているということでしょうか。

[室河氏]AI/DNN開発が爆発的に加速したことで、状況は変わりつつあると言えるでしょう。自動車メーカーや大学の研究室も、レベル4の実証実験を行っていますし、法規制など解決すべき課題はありますが、完全自動運転を実現できる製品が登場するのも、それほど遠いことではないかもしれません。

室河徹(エヌビディア シニアソリューションアーキテクト)

1992年、日本テキサス・インスツルメンツ株式会社に入社、CPUやDSP、携帯電話向けSoCの製品マーケティング・技術に従事。2015年、エヌビディア合同会社に入社。自動車向けSoCに関する技術に携わっている。

取材協力先

ライタープロフィール

後藤 銀河

アメショーの銀河(♂)をこよなく愛すライター兼編集者。エンジニアのバックグラウンドを生かし、国内外のニュース記事を中心に誰が読んでもわかりやすい文章を書けるよう、日々奮闘中。